The Hugging Face Inference API permet d’appeler plus de 200 modèles d’IA (LLM, génération d’image, embeddings, speech) via une seule API standardisée, sans avoir à héberger les modèles toi-même. En 2026, le service s’appelle officiellement Inference Providers et fonctionne comme un routeur : tu envoies ta requête à Hugging Face, qui la dirige vers le bon partenaire d’infrastructure (Cerebras, SambaNova, Together AI, DeepInfra, fal, Replicate…). Tu paies le tarif du provider, sans markup HF. Voir la documentation officielle Inference Providers sur huggingface.co.

📌 Essentials

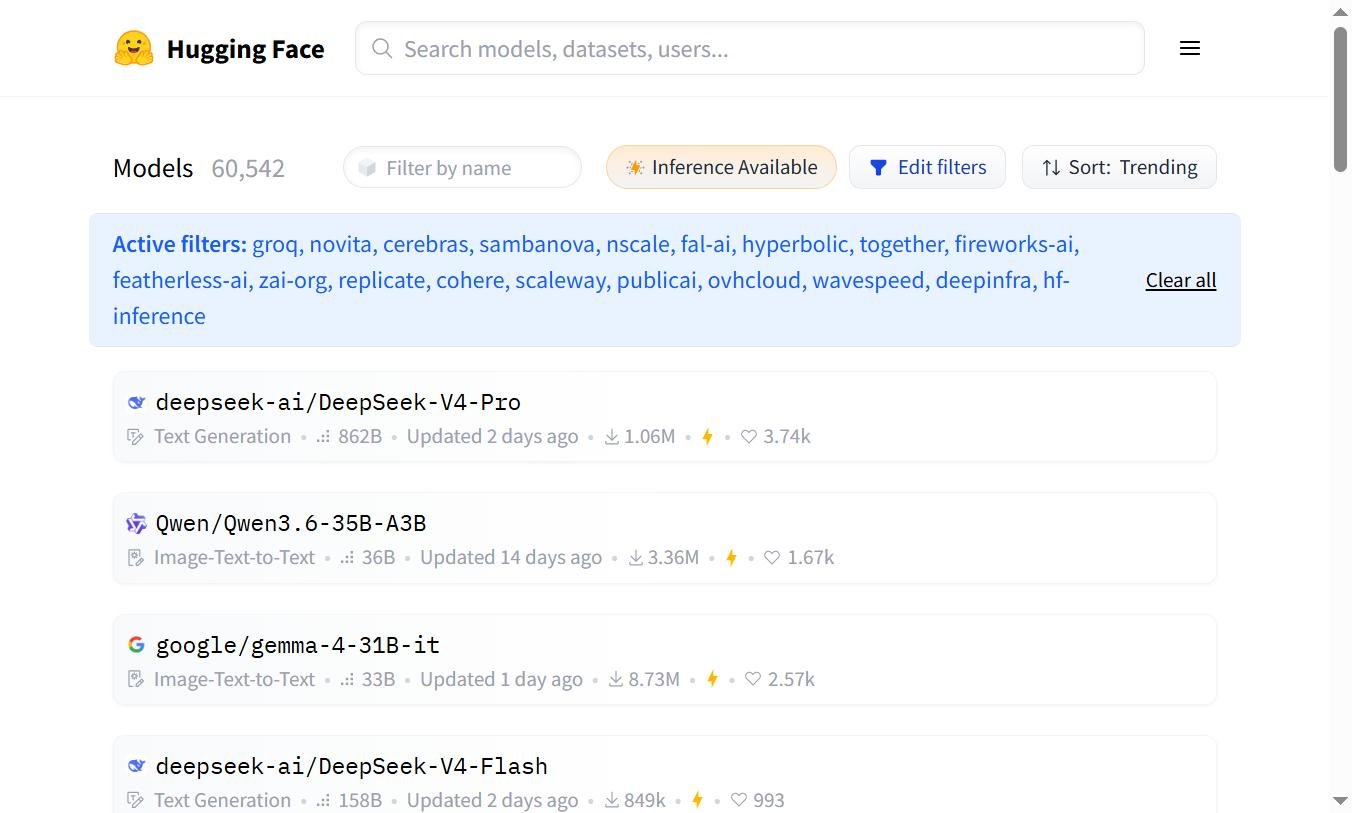

- Une API, des centaines de modèles : DeepSeek V4, Kimi K2.6, Llama, Qwen, GLM-5.1, FLUX.1, etc.

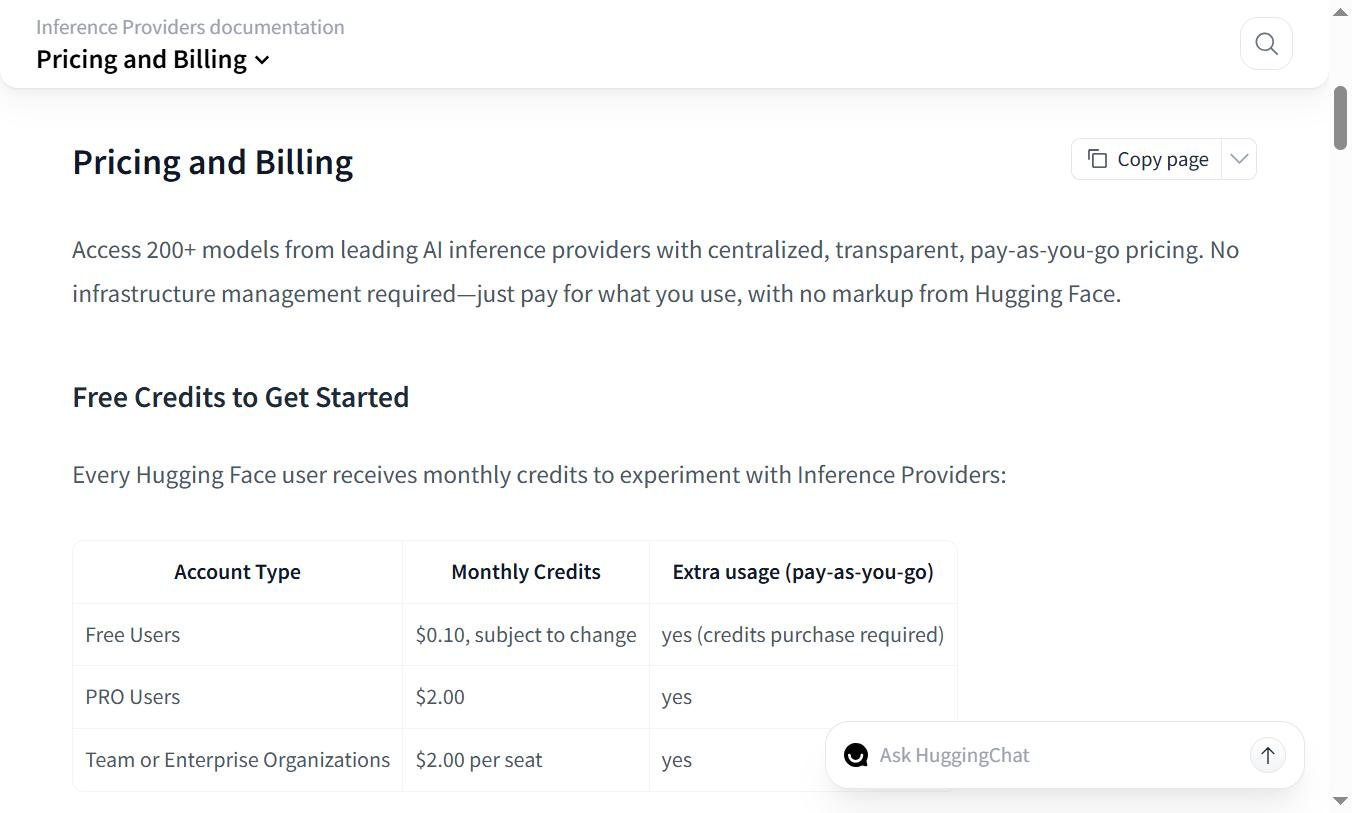

- Free tier : petit quota mensuel offert à tous les utilisateurs Hugging Face connectés.

- Plan PRO : 9 $/mois — 2 $ de crédits Inference + 20× plus de quota ZeroGPU.

- Pricing : pass-through des providers, pas de marge HF (au-delà du free tier).

- Compatible OpenAI : ton code OpenAI marche avec Hugging Face en changeant juste la

base_url.

Contents: Qu’est-ce que c’est • How it works • Prix et free tier • Premier appel en Python • Cas d’usage • Alternatives • FAQ

Qu’est-ce que la Hugging Face Inference API ?

Linference, dans le vocabulaire du machine learning, c’est l’action de faire tourner un modèle entraîné pour obtenir une prédiction. Tu donnes un prompt à un LLM, il te retourne une réponse — c’est de l’inference. Une inference API, c’est donc simplement une API qui te permet de faire ça à distance, sans installer ni faire tourner le modèle sur ta machine.

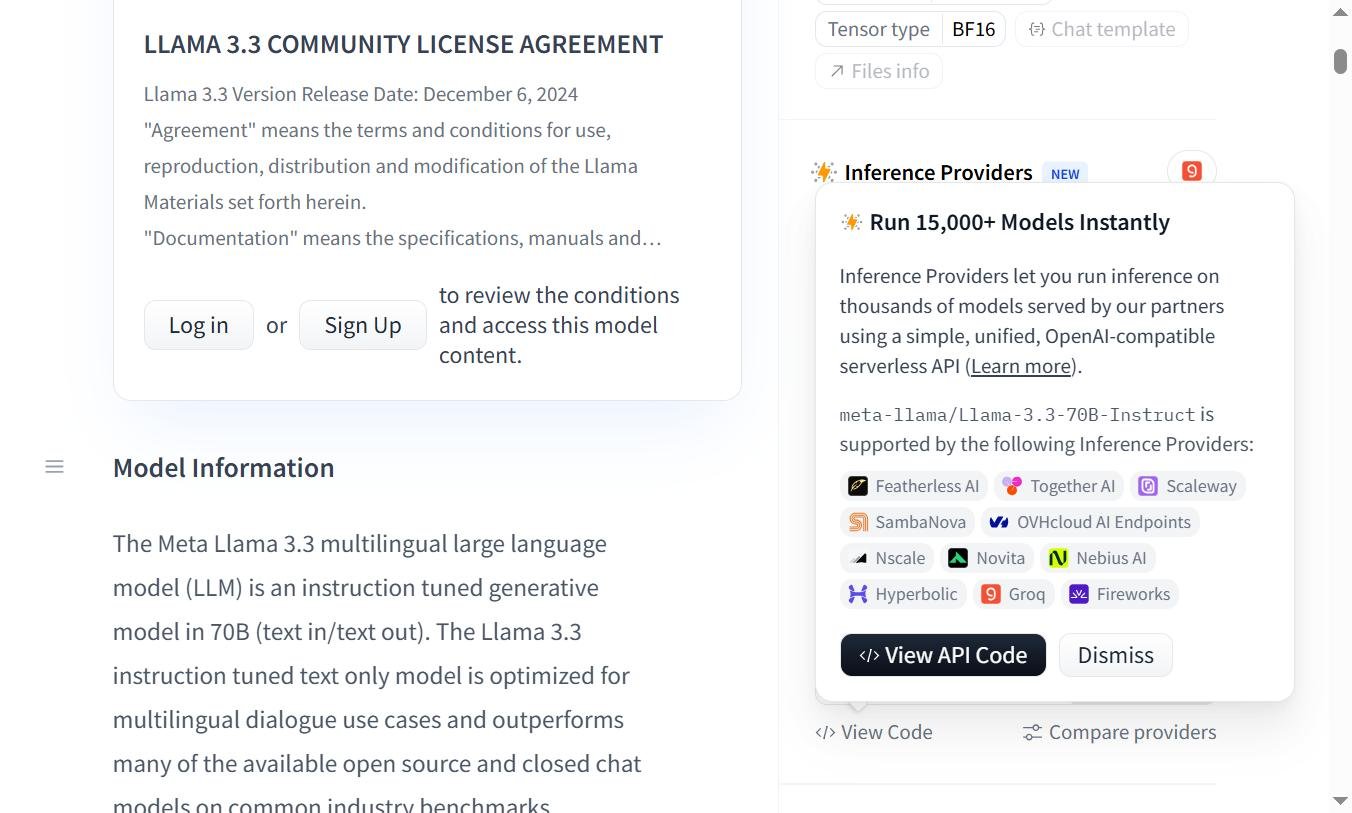

Hugging Face héberge la plus grosse bibliothèque de modèles open-source au monde (plus de 1 million sur le Hub). Mais faire tourner un modèle de 70 milliards de paramètres demande un GPU à 10 000 € minimum. L’Inference API règle ce problème : tu utilises l’infrastructure des partenaires de HF, tu paies à l’usage, et tu ne gères aucune infra.

⚠️ Attention au vocabulaire : ne confonds pas Inference API / Inference Providers (serverless, pay-as-you-go, multi-providers) avec Inference Endpoints (infrastructure dédiée, facturée à l’heure, pour des charges de production stables). L’ancien nom « Inference API (serverless) » a été rebrandé « Inference Providers » en 2025 — beaucoup d’articles encore en ligne utilisent l’ancien terme.

Comment fonctionne l’Inference API en 2026 ?

Le concept clé d’Inference Providers, c’est le routage. Tu n’appelles pas directement un serveur GPU — tu appelles l’API Hugging Face, qui dispatche ta requête vers le partenaire le plus adapté.

- Tu choisis un modèle sur le Hub Hugging Face (ex.

deepseek-ai/DeepSeek-V4-Pro). - Tu envoies une requête avec ton token Hugging Face. Pas besoin d’un compte chez chaque provider.

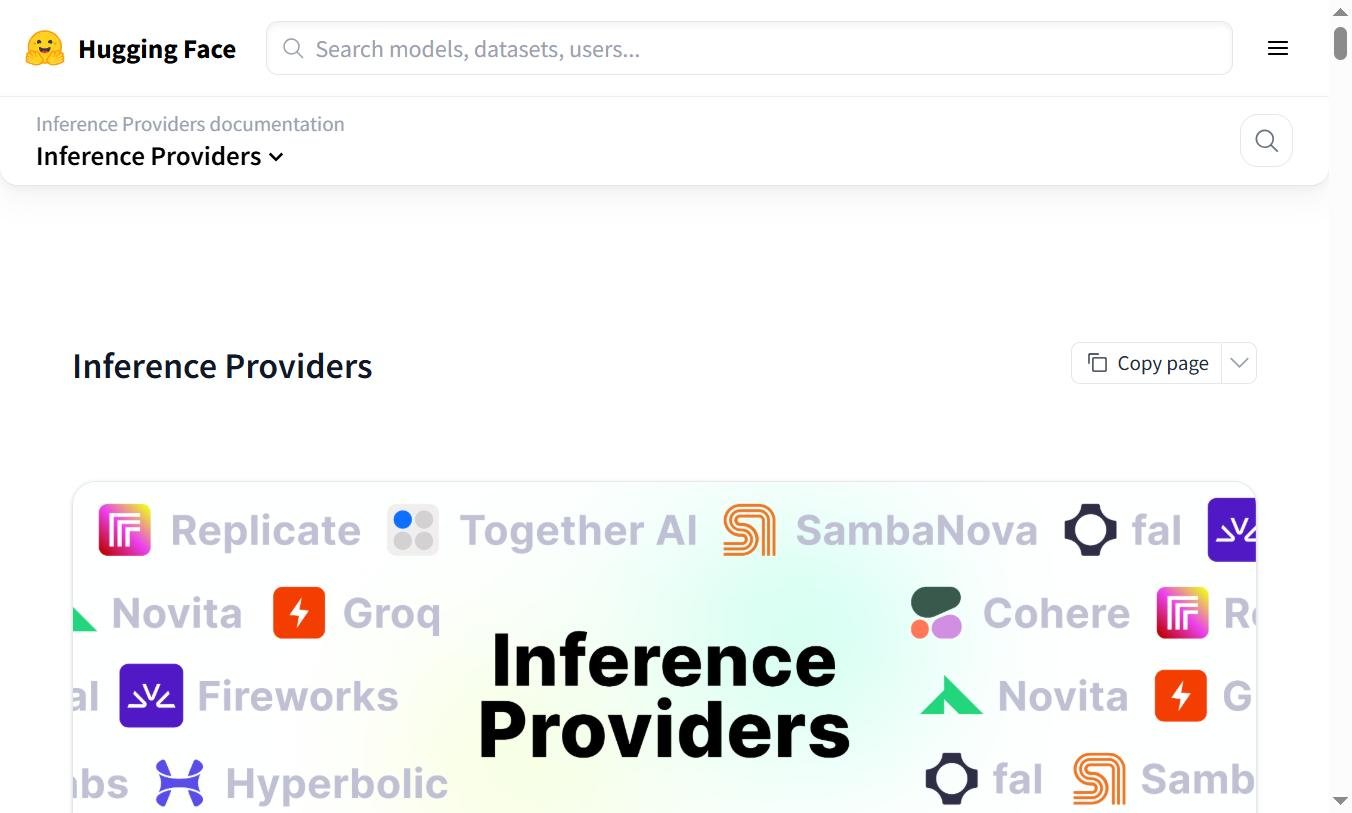

- HF route la requête vers un provider partenaire qui héberge le modèle. Plus de 15 partenaires en mai 2026 : Cerebras, SambaNova, Together AI, DeepInfra, fal, Replicate, Public AI, Novita, Nebius, Hyperbolic, Groq, et d’autres.

- Le provider exécute le modèle sur son infra et renvoie la réponse à HF, qui te la transmet.

- Tu es facturé par HF au tarif du provider, sans markup.

Tu peux choisir le mode de routage avec un suffixe sur l’ID du modèle :

:fastest(par défaut) : provider le plus rapide en throughput.:cheapest: provider le moins cher au token de sortie.:preferred: suit ton ordre de préférence configuré dans les settings.:nom_du_provider: tu forces un partenaire précis (ex.:sambanova,:deepinfra).

Prix et free tier de la Hugging Face Inference API en 2026

Le pricing tient en quelques lignes claires.

| Plan | Prices | Crédits Inference | Au-delà |

|---|---|---|---|

| Free | 0 € | Petit quota mensuel offert | Pay-as-you-go |

| PRO | 9 $/mois | 2 $ de crédits + 20× quota ZeroGPU | Pay-as-you-go |

| Team | 20 $/mois/siège | Pool partagé | Pay-as-you-go |

| Enterprise | À partir de 50 $/mois | Custom + SLA | Pay-as-you-go |

Au-delà des crédits, tu paies au temps de calcul × prix horaire du hardware utilisé. Exemple concret donné par HF : une requête à black-forest-labs/FLUX.1-dev qui prend 10 secondes sur un GPU à 0,00012 $/seconde te coûte 0,0012 $. Soit moins d’un dixième de centime par image. Tarifs complets sur la page pricing officielle de Hugging Face.

Pour un LLM, tu paies au million de tokens — les tarifs varient selon le provider routé et le modèle. DeepSeek V4-Pro via DeepInfra tourne autour de 0,30 $ par million de tokens d’entrée et 1 $ de sortie en mai 2026. Llama 3.3 70B coûte beaucoup moins. Vérifie toujours le prix exact sur la page du modèle dans le Hub avant de partir en production.

Premier appel à la Hugging Face Inference API en Python

Trois étapes pour appeler ton premier modèle.

1. Installe le SDK et connecte-toi

pip install huggingface_hub

huggingface-cli login

# Colle ton token (settings → Access Tokens, droits "Inference Providers")2. Premier appel : conversation avec un LLM

from huggingface_hub import InferenceClient

client = InferenceClient()

completion = client.chat.completions.create(

model="deepseek-ai/DeepSeek-V4-Pro:cheapest",

messages=[

{"role": "user", "content": "Explique le RAG en 3 phrases."}

],

)

print(completion.choices[0].message.content)Le suffixe :cheapest demande à HF de router vers le provider le moins cher pour ce modèle. Tu peux mettre :fastest, :preferred ou nommer un provider directement (:deepinfra, :sambanova, etc.).

3. Génération d’image avec FLUX

from huggingface_hub import InferenceClient

client = InferenceClient()

image = client.text_to_image(

"A cyberpunk cat reading a book in a Tokyo café, neon lights, cinematic",

model="black-forest-labs/FLUX.1-dev",

)

image.save("cat.png")Tu viens de coder un mini ai image generator en 6 lignes. Le même principe marche pour les modèles speech-to-text, text-to-speech, embeddings, traduction, classification.

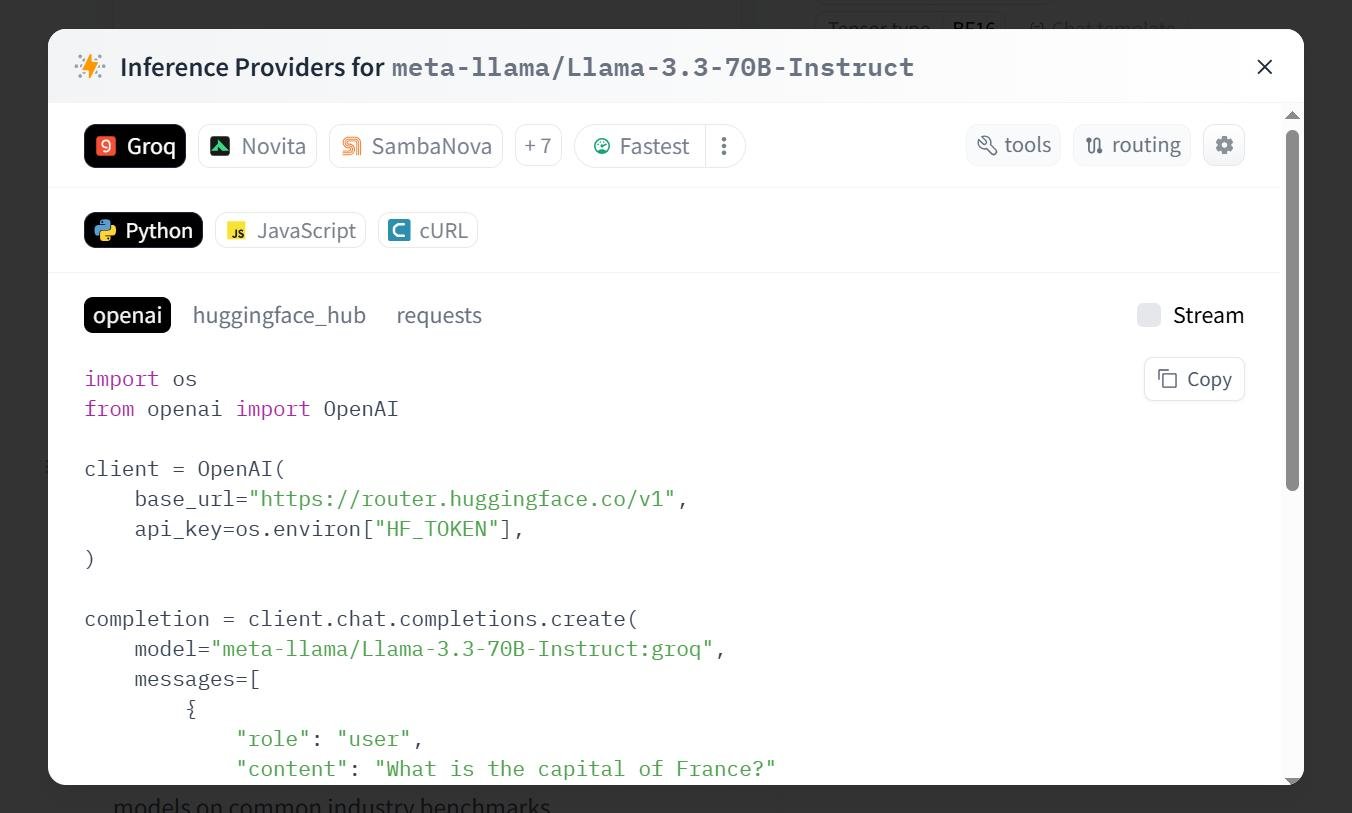

Compatibilité OpenAI : un seul changement

Si ton code existant utilise le SDK OpenAI, tu peux pointer vers le router HF en changeant juste la base_url :

from openai import OpenAI

client = OpenAI(

base_url="https://router.huggingface.co/v1",

api_key="hf_xxxx", # ton token Hugging Face

)

completion = client.chat.completions.create(

model="deepseek-ai/DeepSeek-V4-Pro",

messages=[{"role": "user", "content": "Hello"}],

)

Cette compatibilité ne couvre que le chat completion. Pour text-to-image, embeddings ou speech, il faut utiliser InferenceClient de huggingface_hub.

À quoi ça sert concrètement ?

- Prototyper rapidement une app IA sans déployer d’infra. Tester 5 modèles différents en changeant un nom dans le code.

- Comparer des modèles open-source sur tes propres prompts avant de choisir lequel mettre en production.

- Bâtir une app RAG en combinant un LLM (Llama, DeepSeek, Kimi) avec un modèle d’embeddings, le tout via la même API.

- Content Generation : ai image generator via FLUX, voix synthétique, transcription audio.

- Apps de niche IA vidéo : transcrire automatiquement des sous-titres, générer des miniatures, classifier du contenu — utile si tu construis un outil dans l’écosystème video ai.

Alternatives à la Hugging Face Inference API

- API directes des providers : Together AI, fal, DeepInfra, Replicate, Cerebras. Tu gagnes parfois quelques cents au million de tokens, mais tu perds la simplicité du multi-provider.

- API officielles des éditeurs : OpenAI, Anthropic (Claude), Google (Gemini), Mistral AI. Plus chères en général, mais avec des modèles propriétaires que HF ne propose pas (GPT-5, Claude Opus 4.7, Gemini 3.1 Pro).

- Auto-hébergement avec vLLM, Ollama ou TGI sur ton GPU. Sens pour des charges très élevées et stables, aucun sens pour du prototypage.

- Hugging Face Inference Endpoints : infrastructure dédiée à l’heure, pour des charges de prod où latence et prédictibilité comptent plus que le pay-as-you-go.

💡 Quand choisir HF Inference Providers : si tu veux tester plusieurs modèles open-source rapidement, si tu veux une seule facture, si tu veux garder le choix entre providers selon les performances. À éviter si tu n’utilises qu’un seul modèle propriétaire massivement (vas direct chez l’éditeur).

FAQ — Hugging Face Inference API

L’Inference API de Hugging Face est-elle gratuite ?

Partiellement. Tout utilisateur connecté reçoit un petit quota mensuel offert pour expérimenter. Une fois le quota consommé, c’est du pay-as-you-go au tarif du provider. Les utilisateurs PRO (9 $/mois) reçoivent 2 $ de crédits Inference par mois en plus, plus 20 fois de quota ZeroGPU.

Hugging Face est-il 100 pourcent gratuit ?

Non, pas en 2026. Le Hub reste gratuit (parcourir, télécharger, créer des Spaces CPU basique). Mais l’Inference Providers, les Spaces GPU (0,40 à 23,50 $/h), les Inference Endpoints et le stockage privé étendu sont payants. Le free tier suffit pour apprendre et expérimenter.

Quelle différence entre Inference API et Inference Endpoints ?

Inference Providers (ex Inference API serverless) : serverless, pay-as-you-go, multi-providers, idéal pour prototyper et pour des volumes irréguliers. Inference Endpoints : infrastructure dédiée facturée à l’heure, pour des charges de production stables.

Quels modèles sont disponibles via l’Inference API ?

Plus de 200 modèles en mai 2026 : DeepSeek V4, Kimi K2.6, Llama 3.3, Qwen, GLM-5.1, Mistral Large 3, FLUX.1, Stable Diffusion XL, Whisper et beaucoup d’autres. La liste évolue chaque semaine.

Hugging Face met-il une marge sur les tarifs des providers ?

Non. HF répercute le tarif du provider sans markup. La marge HF se fait sur les abonnements PRO, Team, Enterprise et sur les Inference Endpoints dédiés.

Une API est-elle toujours payante ?

Non. Beaucoup d’API ont un free tier (Hugging Face, OpenAI, Anthropic avec crédits initiaux, Google Gemini). Le pay-as-you-go reste la norme dès qu’on dépasse les volumes du free tier.

🎯 À retenir

La Hugging Face Inference API (officiellement Inference Providers depuis 2025) est le moyen le plus rapide pour appeler des modèles open-source en production sans gérer d’infrastructure. Free tier généreux pour démarrer, PRO à 9 $/mois pour aller plus loin, pay-as-you-go au tarif des providers ensuite.

Pour démarrer : crée un token sur huggingface.co, installe huggingface_hub, copie l’exemple Python ci-dessus, et tu fais ton premier appel en moins de 5 minutes.